por Cesar Lip Licham *

INTRODUCCIÓN

INTRODUCCIÓN

En la última década del siglo XX, un libro resultó particularmente exitoso: “La Quinta Disciplina. El arte y la práctica de la organización abierta al aprendizaje” de Peter Senge (1), quien desarrolló la idea adelantada por Arie de Geus en su artículo, publicado en 1988, La planificación como aprendizaje. En Shell, planificar significa cambiar de forma de pensar, no hacer planes (2).

La idea de la planificación como un proceso de aprendizaje organizacional, sin embargo, germinó antes. En un artículo publicado en 1959, por Lindblom: “La ciencia de salir bien a pesar de las torpezas” (3), el autor afirma que la creación de políticas gubernamentales es un proceso que llevan adelante los altos directivos cada uno en su unidad, y que este proceso no es ordenado y controlado. Más bien, se da como un proceso desorganizado en el cual las decisiones se toman para resolver problemas que van surgiendo, sin una visión del conjunto, sin siquiera buscar vínculos entre las diversas decisiones. Esto es, meras reacciones ante las continuas contingencias.

Posteriormente, en 1967, Wrapp en su artículo “Los buenos administradores no participan en política” dice que el administrador exitoso es capaz de reconocer lo inútil que es intentar impulsar paquetes completos de programas dentro de una organización. Que los directivos exitosos no actúan después de generar un árbol de decisiones completamente desarrollado, sino que “comienzan por un vástago, le ayudan a crecer, y se dejan pender de las ramas sólo después de haber comprobado cuánto peso pueden soportar.” (4)

Las ideas de Lindblom y Wrapp van a contramano de lo que parece ser la idea común sobre los directivos y estrategas: actúan tras tener claros los planes o estrategias que llevarán a la práctica. Ellos, por el contrario, sugieren que los directivos actúan mediante procesos incrementales desarticulados. Después de Lindblom y Wrapp se han producido muchos avances conceptuales y prácticos que permiten una mayor y sustentada reflexión sobre preguntas básicas tales como ¿Qué es aprendizaje organizacional?, ¿Cómo aprenden las organizaciones?, ¿Cuándo lo hacen?, etc. Em-pecemos por esta última.

CRISIS Y APRENDIZAJE

El mencionado de Geus dirigió las investigaciones del grupo de planificación de la Shell, que lideraba, buscando responder la pregunta: ¿qué permite que una empresa sobreviva y qué determina que otras desaparezcan?, o sea, ¿Por qué unas organizaciones fracasan y otras tienen éxito?. Tras estudiar 30 empresas que habían desarrollado actividades por más de setenta y cinco años, alguna hasta por setecientos años, la conclusión fue que una empresa será exitosa si tiene capacidad de aprender, definiendo aprendizaje institucional como un proceso por el cual los equipos directivos cambian sus modelos mentales comunes acerca de su empresa, sus mercados y sus competidores. Asimismo, postula –avanzando sustantivamente sobre Lindblom y Wrapp- que la planificación empresarial es un aprendizaje institucional ya que el éxito deriva de la capacidad de los equipos de alta dirección para captar que está pasando en su medio ambiente y, sobre esa base, emprender las actuaciones empresariales adecuadas (2,5).

Pero, podemos preguntarnos, ¿cuándo se da este aprendizaje?, ¿aprenden las organizaciones continuamente o en situaciones especiales?.

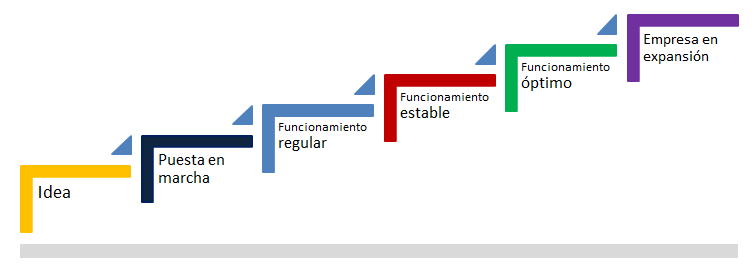

Cuando una organización está ya establecida, se espera que el accionar cotidiano de sus directivos se caracterice por lo rutinario y que los eventuales desajustes entre lo que sus usuarios demandan y lo que la organización produce sean sólo de orden cuantitativo. En tal situación, la oportunidad de aprender no es significativa. Esta era, en general, lo que ocurría desde la finalización de la Segunda Guerra Mundial hasta mediados de la década de los setenta del siglo XX. Después, los tiempos se volvieron turbulentos y frecuentes las crisis por desajustes cualitativos entre los productos ofertados por las organizaciones y los que demandan lo usuarios. Este tipo de desajuste (cualitativo) que Ansoff denominó “problema estratégico“, para cuya resolución formuló la primera propuesta de planeamiento estratégico (6).

Crisis, programación y aprendizaje

Una importante dimensión de las crisis organizacionales son las percepciones sobre ellas. En general, las organizaciones tienden a percibir que las causas de las crisis que las afectan –cuando las perciben- están en el medio externo (7).

Las percepciones que tienen las organizaciones nunca son por completo exactas. La distorsión entre la realidad y cómo ésta se percibe es un fenómeno que, en mayor o menor medida, está globalmente difundido, tanto si tratamos de la percepción individual o de la colectiva. Finalmente, es el grado de distorsión lo que cuenta.

El asunto es complejo. En una organización en crisis, ésta puede derivar de las percepciones erróneas que tienen sus directivos del contexto, de la propia organización o de la relación entre ambos, pero también la crisis puede derivar de lo que debe hacerse (las acciones que deben o que no deben realizarse) tanto para evitar una crisis o, en el peor de los casos, para enfrentarla. La percepción errónea de la realidad y la acción errónea para modificar la realidad llegan a formar un círculo vicioso.

Los equipos directivos de las organizaciones deciden a veces explícitamente, pero con mayor frecuencia lo hacen de forma implícita, cuáles aspectos del contexto observar y cuáles ignorar. Además, la interpretación de lo que observan la hacen en términos de sus metas, métodos y competencias actuales. Entonces, si bien una crisis puede presentarse por cambios importantes en el medio externo, enfrentarla exitosamente depende de las capacidades internas, dentro de ellas resalta la capacidad que tiene una organización para aprender. En este aprendizaje, según Starbuck (6), el proceso clave es la programación, esto es, la estandarización como programas de las actividades exitosas.

Sin embargo, el mismo Starbuck (6) hace notar que la programación en relación con el aprendizaje tiene un carácter paradójico. Si bien la programación causa el éxito, y el éxito fomenta la programación, el éxito también lleva a considerar el programa como la mejor manera de responder a los cambios que sufre la organización provocando el descuido de los recursos y de las oportunidades para adaptarse a los cambios ambientales y evitar o enfrentar una crisis. La programación es, entonces, un arma de doble filo: por un lado, permite a una empresa actuar de forma autónoma y las acciones autómatas por lo general son prerrequisitos para el éxito. Por el otro lado, la programación convierte a la empresa en una organización menos sensible a los eventos ambientales, menos sensible para la detección de los cambios externos hasta que ya son evidentes para todo el mundo, y lo que es peor aún, la programación vuelve a la institución menos capaz de responder a los eventos ambientales aunque los perciban.

Privilegiar la deseable y necesaria estabilidad de la estructura de una organización también hace que se cultive la racionalización de las primeras señales de crisis, y que las dificultades que se aprecian en el rendimiento de una organización se atribuyan a cambios ambientales transitorios. En este sentido, la acción correcta es esperar y fortalecer las prácticas tradicionales que tan buenos resultados dieron. Esto es, sólo hay que ajustarse el cinturón temporalmente, aumentar el control interno y restringir cualquier gasto innecesario.

Crisis: amenaza y oportunidad

Sobre la base de lo anterior, generalizando, se puede decir que los procesos que conducen al éxito, también pueden conducir al fracaso. Esta es una de las tantas paradojas que se encuentran en la gerencia. Esto trae a colación el antiquísimo saber chino, convertido en un lugar común dentro de la administración, en el cual el ideograma que significa “crisis” está conformado por dos símbolos, de los cuales uno significa peligro, amenaza, y el otro, oportunidad (Gráfico N°1). Esto es, las crisis son tiempos de peligro, pero también de oportunidad, sobre todo de oportunidad para que la organización aprenda, dice Starbuck (26).

En el estudio que de Geus y sus colaboradores dieron a conocer mostraron que la mayoría de las empresas longevas había anticipado la necesidad de cambiar, mínimo una vez durante su vida, y que con frecuencia, esa oportunidad había nacido de una crisis en medio de una nueva amenaza proveniente del ambiente de negocios. La capacidad de sobreviencia de una empresa parece estar en su capacidad innata para explorar esas crisis y transformarlas en nuevos negocios. En detectar la inminencia de la crisis, pero no como una crisis, sino como una nueva oportunidad, una ruta alternativa para el crecimiento (5).

Sin embargo, una cosa es identificar una oportunidad o amenaza, y otra el estimular el cambio necesario para aprovechar aquella oportunidad. La capacidad para ver oportunidades dentro de las crisis, evidentemente, no es una condición innata en las organizaciones. Es una capacidad adquirida, aprendida. Pero, ¿cuándo se aprende?

APRENDIZAJE PERMANENTE

Tiempos de incertidumbre

El cambio en el contexto ha pasado a ser la norma y no la excepción, por lo tanto, la desadaptación cualitativa de las organizaciones a sus contextos es algo que se espera pueda suceder en cualquier momento. Para estas situaciones de incertidumbre sobre el futuro de los mercados se ha postulado como requisitos para el éxito el aprendizaje organizacional de alto nivel, eficaz y continuo, y el subsiguiente cambio corporativo (5).

Más aún, Ian Mitroff creó, hace cerca de 13 años, el Centro de Gestión de Crisis de la Universidad de South California, teniendo como idea central que en el mundo actual la cuestión no es si una crisis mayor afectará a una organización, sino cuándo sucederá, de qué tipo será y cómo la afectará. Por lo tanto, no hay más alternativa que prepararse para las crisis, cuyo número está aumentando, no disminuyendo (8). Las crisis son, ahora, inevitables, “permanentes” (9).

En el campo de la salud, nuestras instituciones tienen un importante caudal de experiencia enfrentando situaciones de emergencia y riesgo, como el caso de los desastres naturales y epidemias. Sin embargo, la llamada por Mitroff y colaboradores Gestión de crisis tiene como campo de trabajo principalmente las crisis causadas por los humanos. A diferencia de los desastres naturales, las crisis causadas por los humanos son evitables. Para ello es necesario contar con mecanismos de detección constantes de señales vigilando el ambiente organizacional.

El principal enemigo, la principal barrera para sufrir una crisis es el rechazo de la idea de que nuestra organización se verá afectada por alguna crisis importante y que amenazará su sobrevivencia.

Desagregando, el éxito, la supervivencia de una organización por largo tiempo depende de cuatro factores: a) su capacidad de adaptación al mundo exterior (aprendizaje); b) su carácter e identidad (personas); c) sus relaciones con las personas e instituciones dentro y en torno a si misma (ecología); y d) la forma como se desenvuelve a lo largo del tiempo (evolución) (10). De estos cuatro factores, el aprendizaje es el que aparece primero y el más accesible de las capacidades mencionadas. Las organizaciones deben ser sensibles a lo que ocurre dentro de ella y en el medio que la rodea, y cuando el medio ambiente organizacional cambia, no se trata de hacer de una manera diferente las mismas cosas, sino de ser diferente (9).

Es difícil encontrar a un directivo que no maneje el discurso del cambio, de la incertidumbre, y últimamente de la volatibilidad. Sin embargo, las crisis siguen produciéndose y acabando o dejando heridas de muerte a las organizaciones. ¿Por qué ocurre eso?. Los gerentes no “ven”, no perciben lo que ocurre fuera de la organización.

El caso de los hospitales en el Perú es un claro ejemplo de la última afirmación. Los hospitales son organizaciones que no ven que ocurre en su medio ambiente, no conocen –de hecho no realizan estudio alguno- sobre las necesidades de salud de la población bajo su responsabilidad, lo cual deriva en la ausencia de un accionar proactivo para resolver el problema estratégico que ahora enfrentan: sus servicios no son lo que la población necesita. Los directivos de los servicios de salud no desarrollan su sensibilidad para captar las señales de presiones externas a la organización y el cambio que ellas vienen procesando. ¿Por qué este descuido para desarrollar una capacidad directiva estratégica?. De Geus (5) menciona cinco posibles respuestas:

1. Los directivos son ciegos, sordos y/o estúpidos. Más allá de los ejemplos de decisiones estúpidas tomadas por directivos de importantes empresas, nadie cree que eran sordos, ciegos o estúpidos. El problema planteado no tiene que ver con una inteligencia aislada, sino con cómo se hace uso de la inteligencia de toda la empresa, de su capital intelectual.

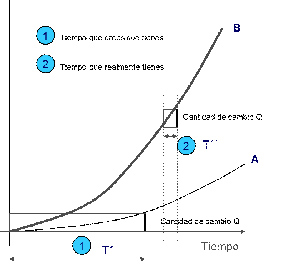

2.Sólo conseguimos ver una crisis cuando ya estalló frente a nuestros ojos. La mayoría de las empresas desarrollan un patrón: a) cuando ya la crisis es evidente para todo el mundo se quiere cambiar; b) Cuando se toma conciencia de lo inevitable que resulta cambiar, ya no queda tiempo; c) como hay poco tiempo, los opciones ya son pocas y no siempre las mejores; d) casi por definición estas opciones son muy duras y devastadoras para la moral de los trabajadores; e) la crisis es un círculo vicioso: mientras más al fondo se está, menos opciones son viables y es menor el tiempo con lo cual se reduce más aun sus posibilidades, lo que a su vez profundiza la crisis.

3. Logramos ver sólo aquello que ya hemos conocido (al menos en parte). Según, la psicología cognitiva, las personas solamente consiguen “ver” lo que ya experimentaron –de alguna forma, al menos. Para recibir una señal del mundo exterior, esa señal precisa encajar en alguna matriz ya presente en la mente, matriz que es fruto de eventos anteriores.

4. Ceguera emocional (“no hay peor ciego que el que no quiere ver”). A las personas y organizaciones –evidentemente, estamos haciendo referencia a sus directivos- no les gusta el dolor emocional que todo cambio fundamental produce, lo que influye para no percibir la mudanza que podría obligarnos a un doloroso cambio.

5. Vemos sólo aquello que es relevante para nuestra visión del futuro. Abundemos sobre esto enseguida, pero es importante tener presente que la naturaleza cognitiva de la adaptación que se revisará en adelante se basan en estudios realizados en individuos y no en una “mente colectiva”.

LA MEMORIA DEL FUTURO

David Ingvar, jefe del departamento de neurobiología de la Universidad de Lund, Suecia, publicó, en 1985, resultados de su investigación que demuestran que el cerebro humano está siempre buscando darle sentido al futuro (5).

Según Ingvar, en cada momento de nuestra vida, nuestro cerebro elabora planes de acción y programas para el futuro, vinculados a condiciones hipotéticas de su medio ambiente. Los planes son creados por los lóbulos prefrontales y almacenados como secuencias lógicas, como una serie de acciones posibles: “si pasa esto, haré aquello”. Se trata de lapsos de tiempo de previsión de un futuro y en cada plan se combina una condición hipotética futura del medio ambiente con una opción de acción. Esta actividad mental se realiza a lo largo de todo el día, independientemente de lo que estamos haciendo, pero es mayor durante el sueño.

Los humanos visitamos el futuro y recordamos esas visitas: tenemos “una memoria del futuro”. La memoria del futuro que es un proceso interno del cerebro y está relacionado a la capacidad de lenguaje y a la percepción, serviría para ayudarnos a distinguir entre la infinidad de imágenes y sensaciones que llegan al cerebro, cuáles son relevantes. Percibiremos algo como dotado de significado en el caso que sea significativamente compatible con una memoria que hayamos fabricado de un futuro anticipado.

Entre las personas “normales”, siempre según Ingvar, cerca del 60 por ciento de esos futuros anticipados son favorables (suceden cosas buenas en ellos). El otro 40 por ciento de los futuros anticipados son desfavorables. Si se rompe ese equilibrio a favor de los futuros anticipados favorables tendremos los llamados coloquialmente “optimistas patológicos”, mientras que si el disbalance es hacia el sentido contrario se tendrá un “pesimista incorregible”. Además, mientras más saludable el cerebro, más caminos alternativos fabrica, siempre guardando un razonable equilibrio ente condiciones favorables y desfavorables. En suma, fabricamos y almacenamos grandes cantidades de opciones para el futuro, mucho más de lo que jamás podremos realizar.

Ingvar sugiere que la función de la “memoria del futuro” no seria tanto prepararnos para hacer luego que uno de los futuros visitados se materialice, o sea, no constituye esencialmente un proceso de previsión, sino que tiene la finalidad de actuar como filtro que ayuda a los humanos a manejar la sobrecarga de información a la que está constantemente sujeto. Nuestras memorias del futuro proporcionarían una guía subconsciente que nos ayuda a determinar cuáles informaciones recibidas son relevantes. Los lapsos de tiempo funcionan como formatos con los cuales deben ser confrontadas las señales recibidas. Si la información recibida coincide con uno de los lapsos alternativos, ella será comprendida. La información se torna, entonces, en conocimiento y la señal adquiere significado. En este sentido, solamente percibiremos una señal en el ambiente externo si es pertinente a una opción de futuro que ya tenemos construida en nuestra imaginación. Por lo tanto, mientras más memorias del futuro construyamos, más abiertos y receptivos estaremos a las señales del mundo exterior.

Aquí aparece clara la base de la preparación para detectar señales tempranas que permitan evitar y enfrentar una crisis, propugnada por Mitroff (9), o porqué Arie de Geus (4) atribuye el éxito de la Shell en los ochenta a la construcción de escenarios futuros.

Si el aprendizaje comienza con la percepción, entonces, la teoría de las memorias del futuro tiene una gran importancia para la dirección de las organizaciones en tiempos de incertidumbre. La percepción no es un acto pasivo de observación y de registro de los datos derivados de ella; la percepción para el ser humano es comprometerse activamente con el mundo. Asimismo, en las empresas, la percepción debe ser activa, se requiere del esfuerzo deliberado de grupos capacitados para “visitar su futuro” y desarrollar lapsos de tiempo y opciones.

El aporte fundamental de Ingvar ha sido encontrar la base biológica (circuitos neuronales) que explican las múltiples observaciones que habían hecho los psicólogos acerca del papel que juegan los sueños, las ideas, los conocimientos, las emociones y los mensajes en la orientación de la percepción y de la acción. En las personas construir nuestras memorias del futuro es un acto natural que, aunque se puede potenciar enormemente, tiene como base una capacidad innata. Sin embargo, una empresa no tiene esta capacidad innata, por ello, la gerencia debe tomar medidas específicas para producir tales memorias. Las personas producimos memorias del futuro espontánea y subconscientemente. Las organizaciones no las producen espontáneamente, tienen que realizar un trabajo conciente especialmente dirigido a ello.

Finalmente, la teoría de Ingvar explica en gran medida por qué los directivos no reconocen las señales tempranas de una crisis, pero también a partir de esta teoría se puede sostener que las empresas tienen necesidad de desarrollar su sensibilidad para detectar cambios en su medios ambientes externo e interno descubriendo mecanismos que le permitan construir una memoria organizacional del futuro (5).

Las memorias del futuro organizacionales se denominan escenarios en el léxico de la planificación. La planificación por escenarios es una técnica que ayuda para que los directivos abandonen la premisa de que existe un futuro único y previsible. La idea es que siempre hay más de un escenario y cada uno de ellos es sólo una historia imaginada sobre el futuro.

EL APRENDIZAJE POR ACOMODACIÓN

Según Jean Piaget (11), el aprendizaje puede abordarse de dos modos: a) la adquisición por el organismo de nuevas respuestas a situaciones específicas (por asimilación), y b) la adquisición de una nueva estructura de operaciones mentales (por acomodación). Mientras la primera es transitoria, la otra es estable y duradera. Las personas procesamos ambos tipos de aprendizaje, aunque con diferente relación a lo largo del proceso cognitivo.

El aprendizaje por asimilación significa absorber información para los cuales quien aprende ya posee estructuras mentales que posibilitan reconocer y dar significado a la señal. Usando las ideas de Ingvar puede decirse que el aprendiz ya tiene una memoria del pasado o del futuro donde cualquier nueva información encaja.

El aprendiz logra fácilmente percibir, asimilar y actuar sobre la base de esta nueva información (5). La mayoría del trabajo operativo –ya sea de atención de salud o de actividades administrativas- en las organizaciones de salud está comprendida en esta categoría. Por ejemplo, una instancia directiva de una organización de la salud reconoce rápidamente un aumento importante en la tasa de incidencia de una enfermedad; dichas instancias cuentan con estructuras y procedimientos para poder dar significado a la señal. Un ejemplo, es el sistema de vigilancia epidemiológica del Ministerio de Salud: la institución, en todos sus niveles, está presta para captar la información, procesarla, analizarla y llegar a conclusiones, y sobre la base de ellas actuar de acuerdo, a su vez, a procedimientos establecidos con anterioridad.

La asimilación es el modo que acude a la mente de la mayoría de personas cuando piensa en aprendizaje.

Quedan dentro de esta categoría el entrenamiento (por ejemplo, cómo suturar una herida, extirpar una neoformación cerebral, confirmar un diagnóstico, etc.) y la transmisión como las tradicionales clases magistrales. Quienes tienen esta perspectiva del aprendizaje tienden a igualar aprender con enseñar y, por ejemplo, no le encuentran la lógica a la afirmación: el liderazgo se puede aprender, pero no se puede enseñar.

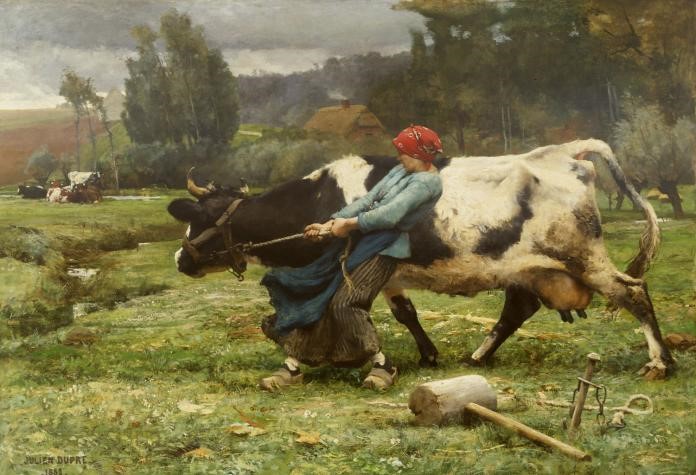

El aprendizaje por acomodación es un proceso mediante el cual el organismo se adapta al ambiente, cambia para poder cumplir con las exigencias que el medio externo le impone. Quien aprende procesa un cambio en la estructura interna de sus creencias, ideas y actitudes. Para aprender por asimilación bastan los libros y las clases magistrales conforme se acostumbra en el aprendizaje escolar convencional. Aprender por acomodación exige mucho más ya que es un proceso que se basa en la experiencia, en el cual el aprendiz se adapta a los cambios del mundo por medio de experimentos profundos en los que participa plenamente, con todo su intelecto y su alma, sin saber cuál será el resultado final. La interrelación con el medio ambiente hace que una persona crezca, sobreviva y desarrolle su potencial (6). Al finalizar el proceso es otro, ya no es una persona que hace las cosas en forma diferente, es una persona diferente.

El aprendizaje por acomodación es entendido en nuestro medio bajo el término “formación”. Por ejemplo, un médico general que participa en un programa de especialización, al finalizarlo ya no pensará ni actuará igual que antes. No se trata sólo de las técnicas nuevas que aprendió (esto corresponde más bien al aprendizaje por asimilación) sino al enfoque de los problemas y de las soluciones.

También las organizaciones, como las personas, tienen aprendizaje por asimilación y por acomodación. Las organizaciones exitosas tienen desarrollados sus mecanismos para aprender por acomodación, es lo que les permite sobrevivir, o en el caso, de los servicios de salud, es lo que les permite cumplir exitosamente con su misión. Son organizaciones que tienen desarrollada la capacidad para dar significado a las señales que recoge del medio externo.

Hay dos momentos diferentes, captar la señal y dar significado a la señal. Para tener éxito se requiere dar a la señal captada el significado adecuado. Por ejemplo, frente a una situación en la cual el servicio de emergencia de un hospital público de Perú obtiene utilidades económicas, un director puede interpretar el hecho como una buena señal de desempeño, mientras que otro directivo frente al mismo hecho muestra preocupación, dado que conoce que los servicios de emergencia públicos en su inmensa mayoría trabajan subvencionados para cubrir el déficit económico que es lo usual. Este último directivo se preocupa en la medida que se pregunta: ¿el que tengamos utilidades en el Servicio de emergencia, no será una señal –indicador- de que no estamos atendiendo a los pobres que lo necesitan?. La decisión-acción frente al mismo hecho variará dependiendo del significado que le atribuyamos.

Así, mientras el primer director del ejemplo mencionado probablemente felicite al personal del servicio y con ello se reforzará la práctica que vienen realizando, el segundo director buscará analizar el tipo de pacientes según condición socioeconómica que se está atendiendo y asegurarse de que no se está excluyendo la atención en los servicios de emergencia a las personas por que no pueden pagarla.

A nivel gerencial, las formas de aprendizaje que llevan al éxito son aquellas que están insertas en la toma de decisiones. Las verdaderas decisiones –en las cuales se llega a un nuevo entendimiento, se toman decisiones y se actúa en consecuencia- son ejemplos de aprendizaje por acomodación.

Podría pensarse, “si tomar decisiones es aprender, entonces todas las empresas aprenden todo el tiempo. ¿Para qué tanto barullo con eso de que tenemos que construir una organización que aprenda?. Mi empresa ya es una organización que aprende“. Si, es probable que su empresa esté aprendiendo y aprendiendo todo el tiempo, pero la pregunta importante en los tiempos actuales es ¿Qué tipo de aprendizaje está realizando su empresa?.

La gran mayoría de empresas realiza un aprendizaje por asimilación. La consecuencia es su falta de capacidad para adecuarse a los cambios externos, debido a que su respuesta será “más de lo mismo”. Frente a los cambios cualitativos en el medio externo, estas empresas, mas bien sus gerentes, tienden a pensar que es un cambio temporal, y sus decisiones son las tradicionales: disminuir costos, cortar beneficios, reducir personal, disminuir la calidad del servicio, entre otras similares. Cada una de estas decisiones no son equivocadas en si, hay situaciones en que son la(s) respuesta(s) adecuada(s). Sin embargo, si el caso de una mudanza cualitativa en el ambiente externo organizacional, tales medidas resultarán no sólo insuficientes sino inadecuadas.

Como ejemplo, una facultad de administración cuyo principal producto son programas de maestría sufre una crisis cuya manifestación central es una abultada deuda que se interpreta como producto de inadecuados sistemas de cobranza, altos costos, exceso de personal contratado y subutilización del personal de planta. Las respuestas no han podidos ser más tradicionales: recortar los gastos, esto es, disminuir los costos (recorte general de la carga horaria de los docentes, austeridad en el uso de material, etc.) y aumentar la producción con los pocos recursos que quedan haciendo más de lo mismo.

Las propuestas de hacer cosas diferentes han sido sistemáticamente rechazadas. Todas estas decisiones basadas en el aprendizaje por asimilación pueden tener resultados peligrosos para esa organización. Si lo que hay es un cambio fundamental en el mundo externo, cambio que los directivos no perciben -y buscan tranquilizarse a si mismos diciendo que es cuestión de ajustarse los cinturones porque es algo transitorio, que hay cambios y dificultades, pero todo volverá a ser normal dentro de poco- los riesgos de esta organización habrán aumentado rápidamente. No está aprendiendo por adaptación. La adaptación, natural o social, implica el desarrollo de una nueva propiedad.

En breve, dice Aries de Geus el proceso natural del aprendizaje tiende a limitar el número de opciones y, además, es lento. La velocidad, apertura, inventiva y coraje de nuestros esfuerzos de aprendizaje deben, todas, ser mejoradas para que nuestra organización sobreviva (5).

La pregunta que cobra actualidad, entonces, es: ¿cómo podemos acelerar y fortalecer el proceso de aprendizaje que venimos llevando adelante?.

EL INCREMENTISMO LÓGICO

Una forma de aprender mediante la creación de estrategias y de crear estrategias mientras se aprende fue elaborada por Quinn (12). Según este autor “La estrategia rara vez está consignada por escrito en algún documento. Los procesos empleados para llegar a la estrategia completa son fragmentarios, evolutivos y en gran medida intuitivos“. Estos procesos, añade, se van conjugando en el tiempo para concebir un nuevo y difundido consenso de acción entre los miembros de la alta dirección que dirigen cada uno de los subsistemas de la organización. Este nuevo consenso surge de la co-evolución de los sucesos externos y las decisiones internas. O sea, que las organizaciones recorren un camino incremental hacia sus estrategias conscientes (13).

La construcción de estrategias es un proceso, además de incremental, proactivo, o sea que no se concibe como una mera reacción de la organización frente a lo que sucede en su ambiente externo, sino que busca adelantarse a los cambios que prevé sucederán en su contexto. Quinn, posteriormente, concretará su propuesta en sendas prescripciones para un manejo incremental de las estrategias en una organización (14).

Mintzberg (15) anota que la postura de Quinn podría interpretarse en dos sentidos, ambos incrementales, uno “como proceso para desarrollar la visión estratégica en sí”, y otro, “como proceso para dar vida a una visión que ya se encontraba en la mente del estratega“. Quinn anota que estas dos posturas son complementarias ya que los “estrategas deben promover visiones estratégicas que, en sí mismas, cambian y mejoran, en un proceso dinámico continuo y pulsante, esto es, en un proceso de aprendizaje continuo” (14). Sin embargo, en este proceso incremental no se da solo en la mente de los estrategas, involucra a toda la organización.

LA EMERGENCIA DE LAS ESTRATEGIAS

Las estrategias en una organización aparecen como las malezas en un jardín postula Mintzberg (16) que tradicionalmente se concibe que la estrategia de una organización es elaborada por los estrategas -técnicos de las oficinas de planificación- y por los directivos, y que el personal de los órganos operativos las ejecutan a pies juntillas (al menos que tratan de hacerlo). Sin embargo, dice Mintzberg, las estrategias, según su origen, puede ser desde absolutamente premeditadas –originadas por los estrategas- hasta un conjunto conformado por respuestas espontáneas. Pudiendo existir una combinación de acuerdo al punto de referencia. La comunidad organizacional puede actuar como un “estratega colectivo”, usualmente en forma inadvertida, esto es cuando varias personas van desarrollando un patrón de comportamiento que termina siendo el predominante en la institución. En la práctica general, la creación de estrategias se ubica en algún lugar de la franja delimitada por sólo estrategias emergentes y sólo estrategias premeditadas.

La idea de las estrategias emergentes se explica metafóricamente con la figura 1 del crecimiento de malezas en un jardín. Las malezas crecen espontáneamente y en cualquier lugar; puede ocurrir que sean extirpadas todas, o que alguna prolifere tanto que llega a ser predominante. Igual sucede con las estrategias, surgen por doquier en una organización, muchas pueden ser coactadas e impedidas de desarrollarse por los directivos o por su propio fracaso, pero otras pueden irse fortaleciendo, ya sea por ausencia de una estrategia premeditada que actúe coactando las espontáneas o por que en la práctica van probándose como una mejor alternativa y fortaleciéndose en la medida de su éxito. Con el tiempo estas estrategias emergentes pueden ser, explícitamente o no, adoptadas por el conjunto de la organización.

Emergencia y aprendizaje

Asociar la estrategia emergente con el aprendizaje no es del todo correcto. Literalmente, emergencia significa algo no proyectado (que emerge sin haberlo planeado).

Las estrategias, entendidas como patrones de acción, pueden formarse debido a la acción de fuerzas externas o en respuesta a necesidades internas, y no por las ideas conscientes de ningún participante. Para hablar de aprendizaje verdadero tiene que ocurrir una confrontación entre el pensamiento y la acción, los participantes deben reflexionar sobre lo que han hecho.

El aprendizaje estratégico consiste en encontrar un nuevo sentido a partir de la combinación de lo esperado, lo actuado y lo logrado. En palabras de Weick (17):

“toda comprensión se origina en la reflexión y en una mirada al pasado”. No es posible aprender sin actuar.

Por lo tanto, desde esta posición, para diversificar, el camino es que la organización ingrese en una variedad de mercados con el fin de averiguar qué es capaz de hacer mejor. Después, sólo continuar en aquellos donde ha funcionado bien. Gradualmente, la estrategia emergerá al encontrar el sentido de lo que hizo que las cosas funcionen. Evidentemente, no se trata de ingresar a tontas y locas en todos los mercados posibles, se trata de aprender mediante el reconocimiento de patrones de la propia conducta, convirtiendo las estrategias emergentes del pasado en estrategias premeditadas del futuro. Esto puede parecer paradójico y en realidad lo es. Es una paradoja que hay que manejar.

Una conducta que es la antítesis de la planificación puede, en ciertas circunstancias, brindar la información necesaria para la creación de la estrategia premeditada.

Una forma errada de planificar consiste en separar a los planificadores de los operadores, tal como lo propuso hace ya cerca de un siglo Frederick W. Taylor, el padre de la administración. Taylor fue quien introdujo en las organizaciones la noción de planificar (prever) y su propuesta central al respecto consistió en especializar a las personas de una organización en dos grupos, el grupo programador y el grupo ejecutor, los primeros como su nombre indica decían qué cosas hacer, además cómo y cuándo hacerlas. El segundo grupo sólo debía limitarse a cumplir estrictamente lo programado.

Este mecanismo de arriba hacia abajo, concreción en la administración del pensamiento cartesiano, que separó pensamiento y acción -y con ello la posibilidad de que planificadores y directivos aprendan a partir de los resultados- sigue siendo el predominante en nuestras organizaciones. Aunque la planificación de abajo hacia arriba tiene defensores importantes, no es un concepto que haya permeado nuestras instituciones.

Una de las versiones más provocadoras fue postulada por dos famosos expertos en marketing, Al Ries y Jack Trout (18), en su libro La revolución del marketing. La táctica dicta la estrategia, donde afirman:

“Nosotros no estamos de acuerdo con la planeación estratégica a largo plazo, con los enunciados e misiones, metas, planes empresariales y presupuestos anuales.

Creemos que la mayoría de gerentes de hoy no comprenden la relación crítica entre la estrategia y las tácticas. Por eso continúan encantados con el proceso de planeación estratégica.

La teoría tradicional dice que la gerencia ejecutiva debe primero fijar la estrategia de una campaña de marketing. Luego, la estrategia debe ser entregada a los gerentes intermedios quienes seleccionan las tácticas a utilizar para adelantar la estrategia.

No estamos de acuerdo con esto. Nuestro concepto es exactamente opuesto.”

Para estos autores, la estrategia se debe desarrollar de abajo hacia arriba y no en el sentido contrario. La estrategia se debe desarrollar partiendo de un conocimiento profundo y del compromiso con las tácticas reales del negocio en sí. (

) Las tácticas exitosas deben imponer las estrategias.

Más allá de la necesaria especificación de los términos: táctica y estrategia, aquí interesa remarcar la idea de que el sentido de abajo hacia arriba en la creación de estrategias o en la planificación es la que permite aprender, mientras que la otra no. Sin embargo, al plantear la construcción de estrategias de abajo hacia arriba no estamos planteando absolutamente lo contrario, como hacen Ries y Trout, estaríamos cayendo nuevamente en la lógica dicotómica. No estamos planteando la antinomia “de abajo hacia arriba o de arriba hacia abajo“, esto es, dos opciones excluyentes. No se trata de escoger entre dos distintas formas, ambas tienes ventajas y desventajas, estamos planteando su complementariedad. Coincidimos con Mintzberg (15) en que la estrategia realizada es, finalmente, una mezcla de estrategia premeditada y estrategia emergente.

La estrategia emergente permite aprender, siempre y cuando lo que las instancias operativas creen sea sistematizada por las instancias directivas que son las que tienen la visión del conjunto de la organización. Por eso, una de las varias capacidades que deben desarrollar los planificadores es encontrar la lógica en acción que tiene la organización. Esto significa, primero, el rastreo de patrones de acción para identificar estrategias recientes en las unidades de la institución que puedan transformarse en estrategias organizacionales más amplias y deliberadas. Segundo, usar el rastreo para realizar el control estratégico mediante la identificación de las estrategias realizadas (los patrones de acción actuales) las cuales deben compararse con las estrategias premeditadas (las que se planearon).

EL APRENDIZAJE ESTRATEGICO

El aprendizaje organizacional es el proceso por el cual los equipos directivos cambian sus modelos mentales comunes de su organización, sus mercados y sus competidores. Por esta razón, se dice que planear es aprender y que el planeamiento es un mecanismo de aprendizaje organizacional. El aprendizaje organizacional es mucho más difícil que el aprendizaje individual. La mayoría de veces, la capacidad de reflexión de los equipos directivos es menor que el de sus miembros en cuanto individuos. Esta definición de aprendizaje organizacional ha sido extraída del Libro La Quinta Disciplina (1), probablemente el punto más alto, al menos el más difundido, del movimiento por crear organizaciones que aprenden que tuvo importante auge en la década anterior, aunque los antecedentes en este tema se remontan a cuarenta años atrás, como mencionamos antes.

Entre las nuevas iniciativas relacionadas al aprendizaje organizacional hay tres que destacan en el contexto de la planificación como aprendizaje: a) aprender sobre creación de conocimientos, b) el método de capacidades dinámicas, y c) la teoría del caos (15).

Aprendizaje como creación de conocimiento

A partir de un concepto introducido por Polanyi (19): “es posible que conozcamos más de lo que creemos“, Nonaka y Takeuchi (20) propugnan que debe abandonarse la vieja moda de pensar que el conocimiento puede ser adquirido, enseñado e impartido a través de manuales, libros o conferencias. Llaman, en lugar de ello, a prestar más atención al aspecto menos formal y sistemático del conocimiento, el tácito. El conocimiento tácito es personal y específico del contexto, difícil de formalizar y comunicar. El otro tipo de conocimiento es el explícito o “codificado” que es el transmisible en un lenguaje formal y sistemático.

Entonces, lo que se plantea a los directivos es convertir conocimientos tácitos en explícitos, lo cual puede hacerse en cuatro momentos:

Socialización: se comparten implícitamente los conocimientos tácitos, muchas veces sin siquiera utilizar el lenguaje; por ejemplo, a través de la experiencia.

Externalización: conversión de conocimientos tácitos en explícitos, con frecuencia mediante usos especiales del lenguaje, como las metáforas y las imágenes.

Combinación: unión y transmisión de conocimientos formalmente codificados de una persona a otra.

Internalización: devolución de los conocimientos explícitos a la forma tácita, como en un aprendizaje mediante la acción, en la cual el aprendizaje se realiza con el cuerpo y en la mente.

Estos modos de conversión de conocimiento se interrelacionan dinámicamente formando una “espiral de conocimientos” (20), como se muestra en la Gráfico N° 2.

Nonaka y Takeuchi (20) dicen que la esencia de la estrategia se basa en desarrollar las capacidades organizacionales para adquirir, crear, acumular y aprovechar los conocimientos. Pero, como el conocimiento es creado sólo por individuos, el rol de la organización es facilitar este aprendizaje. Debe brindar apoyo y estímulo al aprendizaje individual, amplificarlo, cristalizarlo y sintetizarlo a nivel del grupo mediante el diálogo, la discusión, la posibilidad de compartir experiencias y la observación.

Resulta ilustrativo recordar en este punto, que la gran mayoría de los hospitales peruanos no cuentan -en el campo de la gestión- con mecanismos que les permita aprender como instituciones, no son, como diría Senge (1), organizaciones inteligentes. La reinvención de la gestión, o más bien, partir de la nada, es constante. En estas instituciones cada cambio de director general, acontecimiento frecuente, trae aparejado casi de manera invariable el cambio de la gran mayoría de directivos intermedios y operativos.

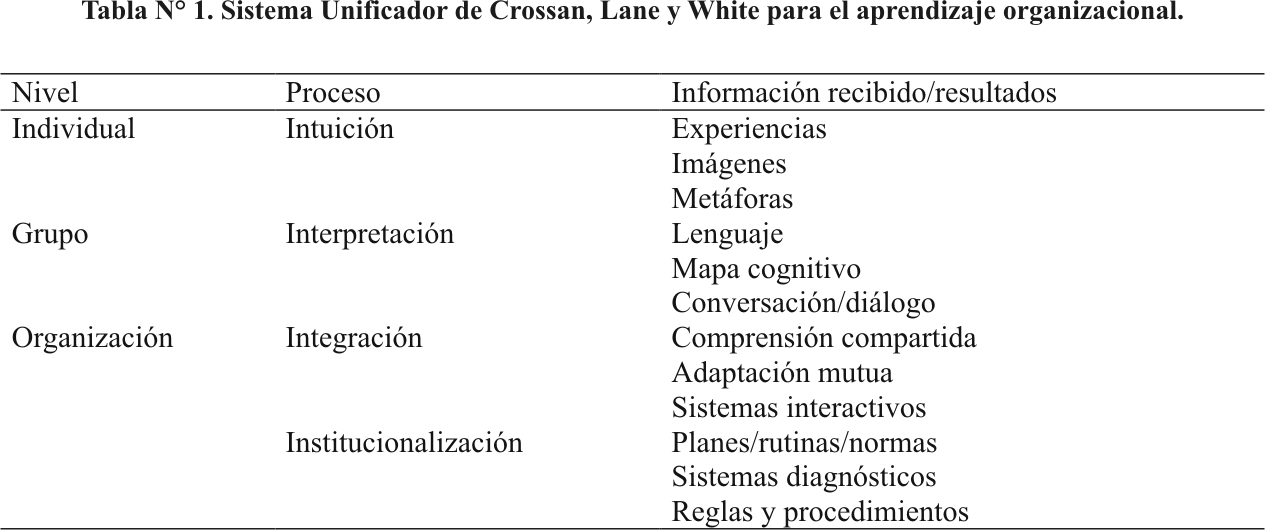

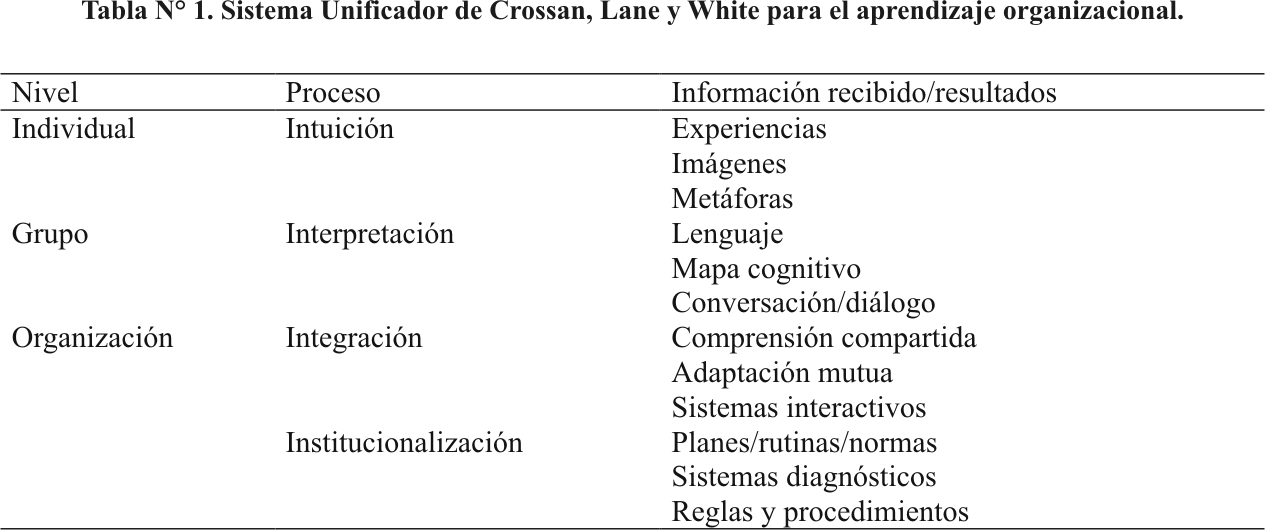

Crossan, Lane y White (21) propugnan que el aprendizaje individual fomenta el aprendizaje colectivo, y que el aprendizaje organizacional es un proceso de cambio en pensamientos y acciones individuales compartido. Ambos procesos se ven afectados por las instituciones de la organización y a la vez están implantados en ellas. Los niveles individual, grupal y organizacional están, dicen Crossan y col., vinculados por cuatro procesos que comprenden cambios de conducta y también cognitivos: intuición, interpretación, integración e institucionalización.

La intuición es un proceso subconsciente que tiene lugar a nivel del individuo. Es el comienzo del aprendizaje, y se produce en una sola mente. Luego, la interpretación recoge los elementos conscientes de este aprendizaje individual, y los comparte a nivel de grupo. Posteriormente viene la integración para cambiar la comprensión colectiva, y funciona como puente hacia toda la organización. Al final, la institucionalización incorpora ese aprendizaje a toda la organización implantándola en sus sistemas, estructuras, rutinas y prácticas. La planificación juega el papel de formalizar el conjunto de estos cuatro procesos.

- En la tabla N° 1 se presenta un sistema unificado para el aprendizaje organizacional elaborado por Crossan, Lane & White (21).

La dinámica de las capacidades organizacionales

Prahalad y Hamel (22) consideran a la planificación estratégica como un proceso de aprendizaje colectivo destinado a desarrollar y luego aprovechar aptitudes distintivas que resultan difíciles de imitar. Sus conceptos más difundidos son tres: principal capacidad, intención estratégica y expansión e influencia. Sobre la principal capacidad, la idea central es que la esencia de una estrategia exitosa se basa en la coincidencia de factores externos e internos y el contenido de la estrategia misma, esto es, en una concordancia estratégica dinámica. Las raíces de una ventaja competitiva pueden encontrarse en las principales capacidades de una firma, en sus productos centrales que son consecuencia del aprendizaje colectivo de la organización. Subyace en estos productos, la principal capacidad de la organización que es una forma de coordinar diversas aptitudes de producción e integrar múltiples corrientes de tecnología.

La intención estratégica consiste en imaginar una posición de liderazgo deseada, y establece los criterios que serán usados por la organización para trazar su progreso. La intención estratégica establece la orientación general e implica dirigir la atención de la organización hacia lo que la firma considera es triunfar. Es, también, papel central de la intención estratégica motivar a la gente comunicando el valor del objetivo, dejar espacio para las contribuciones individuales y de equipo, mantener el entusiasmo a través de nuevas definiciones operativas a medida que cambian las circunstancias, y orientar los recursos en forma coherente. Este concepto corresponde al que es más conocido como visión organizacional.

Finalmente, la expansión se refiere al desajuste entre los recursos de una firma y sus aspiraciones, y la influencia es el aprovechamiento de una base de recursos limitada. Las organizaciones deben aprender como aprovechar una base de recursos limitada.

Caos y aprendizaje

La teoría del caos se originó en la física para comprender sistemas en permanente estado de desequilibrio. En éstas, las perturbaciones constantes pueden aprovecharse para producir un aprendizaje que trascienda las pautas establecidas del pensamiento estratégico, por lo tanto, los propios directivos tendrían que introducir perturbaciones premeditadas dentro de las operaciones, de modo que las incoherencias resultantes pudieran generar nuevos conocimientos (15).

EL ESTRATEGA APRENDIENDO ESTRATEGICAMENTE

Uno de los mitos que se han desarrollado acerca de los planificadores es sobre su capacidad de crear estrategias. Es común la idea de que el estratega tiene un conjunto de estrategias entre las cuales escogerá para recetar la más conveniente en una situación dada que atraviesa la organización. Esta perspectiva no corresponde al mundo real, al menos, en relación con los estrategas exitosos.

Ninguna persona u organización sabe lo suficiente como para resolver todo anticipadamente. Si bien pueden trazarse grandes líneas que orienten el accionar organizacional –tampoco se trata de dejar las cosas al azar y a la capacidad espontánea de reaccionar ante lo que vaya ocurriendo-, el impredecible devenir obliga a desarrollar formas que permitan el aprendizaje activo de la organización y de sus estrategas, siendo una función de éstos impulsar el aprendizaje institucional.

El aprendizaje estratégico implica movilizarse en un continuo cuyos límites extremos son las estrategias completamente premeditadas, por un lado, y las estrategias plenamente emergentes, por el otro. Aprender estratégicamente requiere ganar libertad mental para deslizarse flexiblemente en este continuo creando estrategias a partir de un fecundo diálogo entre el pensamiento y la acción.

REFERENCIAS BIBLIOGRÁFICAS

1. Senge P. La Quinta Disciplina. El arte y la práctica de la organización abierta al aprendizaje. 1ra. Edición. Ed. Granica, Barcelona, 1992. [ Links ]

2. De Geus AP. La planificación como aprendizaje. Harvard Business Review Nº 36. Madrid, 1988:70-74. [ Links ]

3. Lindblom Ch. La ciencia de salir bien a pesar de las torpezas (1959). En: Mintzberg H, Quinn JB. (Eds). El Proceso Estratégico. Conceptos, contextos y casos. Prentice Hall. 2da. Edición, Londres, 1993. [ Links ]

4. Wrapp HE. Los buenos administradores no participan en política. (1967) En: Mintzberg H, Quinn JB. (Eds). El proceso estratégico. Conceptos, contextos y casos. Prentice Hall. 2da. Edición, Londres, 1993. [ Links ]

5. De Geus AP. The living company. Harvard Business Review 1997;75:51-60. [ Links ]

6. Ansoff I. La estrategia de la empresa. Ed. Universidad de Navarra, España, 1965. [ Links ]

7. Starbuck WH, Greve A, Hedberg LT. Respuesta a la Crisis (1978). En: Mintzberg H, Quinn JB. (Eds). El proceso estratégico: Conceptos, contextos y casos. Prentice Hall. 2da. Edición, Londres, 1993. [ Links ]

8. Mitroff I, Pearson C. Cómo gestionar una crisis. Guía para mejorar la preparación frente a una crisis. Editorial Gestión 2000, Bogotá, 1997. [ Links ]

9. Mitroff I, Anagnos G. Managing Crisis before the happen. What every executive and manager needs to know about crisis management. Ed. Amacom, 1ra. Edición, Barcelona, 2001. [ Links ]

10. De Geus AP. A Empresa Viva. Editora Campos, 1ra. Edición, Sao Paulo, 1999. [ Links ]

11. Piaget J. Genetic Epistemology. Editorial Columbia University Press, Columbia, 1970. [ Links ]

12. Quinn JB. Cambio estratégico: El incrementalismo lógico. Sloan Management Review I 1978(20):43-55. [ Links ]

13. Quinn JB. Strategies for Change: Logical incrementalism. En: Mintzberg H, et al. Safari a la Estrategia, Ed. Granica, 1ra. Edición, Barcelona, 1999. [ Links ]

14. Quinn JB. Manejo incremental de las estrategias (1982). En: Mintzberg H, Quinn JB. (Editores). El Proceso Estratégico: Conceptos, contextos y casos. Prentice Hall. 2da. Edición, Londres, 1993. [ Links ]

15. Mintzberg H, Ahlstrand B, Lampel J. Safari a la Estrategia. Una visita guiada por la jungla del management estratégico. Editorial Granica, Barcelona, 1999. [ Links ]

16. Mintzberg H. The Rise and the Fall of Strategic planning. Reconceiving roles for planning, plans, planners. Ed. The Free Press, 1st. edition, Ontario, 1994. [ Links ]

17. Weick KE. The Social Psycology of Organizing. Reading, Illinois. MA: Addison-Wesley, 2nd. edition, 1979. [ Links ]

18. Ries A, Trout J. La Revolución del Marketing. La Táctica dicta la Estrategia. Editorial McGraw Hill, Montreal, 1989. [ Links ]

19. Polanyi M. The Tacit Dimension. Ed. Routledge & Kegan Paul, New York, 1966. [ Links ]

20. Nonaka I, Takeuchi H. The Knowledge – Creating Company: How japanesse companies create the dynamics of innovation. Ed. Oxford University Press. New York, 1995. [ Links ]

21. Crossan MM, Lane HW, White RE. An organizational learning framework: From intuition to institution. Academy of Management Journal 1999;24 (3):522-537. [ Links ]

22. Prahalad CK, Hamel G. The Core Competence of the Corporation. Harvard Business Review 1990;79-91. [ Links ]

23. Nonaka I. Toward Middle-Up-Down Management. Sloan Management Review 1988; 23(3):9-18. [ Links ]

* Profesor Principal del Departamento Académico de Salud Pública de la Facultad de Salud Pública y Administración Carlos Vidal Layseca de la Universidad Peruana Cayetano Heredia.

Correspondencia: Cesar Lip Licham Correo electronico: c72@wienergroup.com

Publicado en Scielo. Post original aquí.

Si te ha interesado este post, no olvides dejarnos tus comentarios. También apreciamos que los compartas con tus amigos y contactos en las redes sociales. Muchas gracias.

Me gusta:

Me gusta Cargando...

Share

Decisión ahora:

Decisión ahora: Selección de decisiones dentro de 2 años:

Selección de decisiones dentro de 2 años: Probabilidad estimada de que cada resultado pueda ocurrir. Estas probabilidades deben sumar 1.0 para cada conjunto de resultados (ramas) que resultan de una decisión.

Probabilidad estimada de que cada resultado pueda ocurrir. Estas probabilidades deben sumar 1.0 para cada conjunto de resultados (ramas) que resultan de una decisión.

P/F,6%,j) ] (A/P,6%,n)

P/F,6%,j) ] (A/P,6%,n) PIF,6%j)(A/P,6%,n)]==O

PIF,6%j)(A/P,6%,n)]==O INTRODUCCIÓN

INTRODUCCIÓN